L’embargo n’est plus une protection : ce que l’IA change à la divulgation responsable

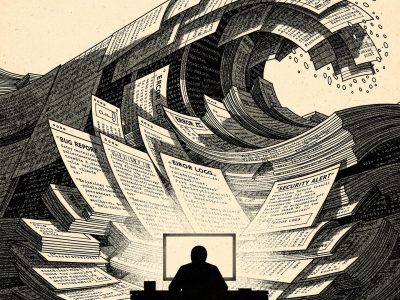

Six CVE dnsmasq, un mainteneur épuisé par le tsunami de bug reports générés par IA, et l’aveu public d’un pivot doctrinal majeur. Lecture d’un signal faible qui pourrait préfigurer la fin d’un modèle vieux de trente ans.

Le 11 mai 2026, Simon Kelley a publié six CVE pour dnsmasq. Il a aussi publié, sans la nommer, la fin d’une époque. Dans le même message, le mainteneur du logiciel qui sert de couteau suisse DNS et DHCP à des millions de routeurs annonce qu’il renonce aux longs embargos de divulgation. La raison est plus structurellement inquiétante que les vulnérabilités elles-mêmes : l’IA produit désormais tellement de bug reports que la rareté de la découverte, fondement caché de la divulgation responsable, n’existe plus.

Six CVE, et un message qui en dit plus que la liste

Le 11 mai 2026, Simon Kelley publie sur la liste de diffusion dnsmasq-discuss un message intitulé Security – IMPORTANT (1). Il y annonce la divulgation simultanée de six vulnérabilités affectant dnsmasq, le serveur léger combinant fonctions DNS, DHCP, TFTP et boot réseau, présent dans une part significative du parc mondial de routeurs, points d’accès Wi-Fi, distributions Linux embarquées, environnements Pi-hole et passerelles OpenWrt. Coordonnée via le CERT/CC sous la note VU#471747 (2), la divulgation est accompagnée de la publication immédiate de dnsmasq 2.92rel2 et de la promesse d’une stable 2.93 dans la semaine suivante.

Les six identifiants concernés couvrent un éventail technique large : un heap buffer overflow exploitable sans authentification dans extract_name() permettant le cache poisoning ou le déni de service (CVE-2026-2291), deux bugs critiques du parseur DNSSEC menant respectivement à une boucle infinie et à une fuite mémoire (CVE-2026-4890 et CVE-2026-4891), un heap-based out-of-bounds write dans l’implémentation DHCPv6 permettant l’exécution de code arbitraire avec les privilèges du processus dnsmasq via un CLIENT_ID surdimensionné (CVE-2026-4892), un bypass des contrôles de source via le mécanisme EDNS Client Subnet de RFC 7871 (CVE-2026-4893), et un buffer overflow dans extract_addresses() exploitable via une réponse DNS malformée (CVE-2026-5172) (3)(4).

L’analyse technique la plus complète est publiée par xchglabs (5), dont le chercheur Royce M est crédité pour cinq des six découvertes. Le PoC public pour CVE-2026-2291 et CVE-2026-4892 démontre que les attaques sont reproductibles avec un harness Python autonome. La sévérité opérationnelle est élevée : CVE-2026-4890 est cotée 7.5 HIGH au CVSS 3.1, et CVE-2026-2291 ne requiert ni authentification ni DNSSEC, seulement que dnsmasq suive une chaîne CNAME vers un serveur autoritaire contrôlé par l’attaquant, ce qui constitue le comportement par défaut du forwarder.

Les distributions majeures ont publié leurs paquets corrigés dans les heures suivant la divulgation. Debian DSA-6264-1 couvre bookworm et trixie (6). Ubuntu USN-8268-1 couvre l’ensemble des versions supportées depuis 16.04 LTS jusqu’à 26.04 LTS (7). SUSE, Red Hat et les distributions communautaires ont suivi le même calendrier resserré.

Cette première lecture, factuelle et technique, est celle qui figure dans la plupart des dépêches publiées la semaine du 12 mai. Elle est complète. Elle est juste. Et elle passe à côté du véritable événement.

La doctrine CVD : généalogie d’une hypothèse devenue fragile

La divulgation coordonnée de vulnérabilités, dite Coordinated Vulnerability Disclosure ou CVD, repose sur un modèle stabilisé depuis le début des années 2000. Un chercheur découvre une faille. Il en informe l’éditeur. Un délai d’embargo est négocié, généralement entre 60 et 120 jours, durant lequel les détails techniques restent confidentiels. L’éditeur prépare un correctif. À l’expiration de l’embargo, la vulnérabilité et son patch sont publiés simultanément. Les utilisateurs disposent ainsi d’une protection avant que les détails ne deviennent publiquement exploitables.

Ce modèle repose sur une hypothèse rarement énoncée mais structurellement déterminante : la rareté de la découverte. Si une vulnérabilité est rare au point que le chercheur qui la signale est probablement le seul, ou l’un des très rares, à l’avoir trouvée, alors l’embargo protège réellement les utilisateurs. L’attaquant moyen ne dispose pas de cette information pendant la durée de l’embargo. Le modèle fonctionne.

Cette hypothèse a toujours été imparfaite. Les services de renseignement disposent depuis longtemps de capacités de découverte avancées. Les vendeurs d’exploits commerciaux, dont Zerodium, Crowdfense ou divers acteurs étatiques, achètent et stockent des zero-days que les éditeurs ignorent. Mais ces acteurs représentaient des cas marginaux, suffisamment rares pour que la doctrine reste opérante à l’échelle globale.

Ce qui change en 2026 n’est pas la nature de cette imperfection, mais son ordre de grandeur. L’irruption des modèles de langage entraînés sur du code, capables de pratiquer un fuzzing assisté, de générer des PoC à partir de descriptions textuelles, et de comparer des millions de patterns vulnérables connus à des bases de code arbitraires, transforme la rareté en quasi-absence. Si dix chercheurs disposant chacun d’un agent IA peuvent identifier le même bug en parallèle, en quelques jours, alors l’embargo de 90 jours cesse de protéger les utilisateurs et commence à les exposer : pendant que l’éditeur prépare son correctif, les acteurs disposant des mêmes outils ont une fenêtre opérationnelle de plusieurs semaines.

La doctrine CVD a été conçue pour un monde où la découverte d’une vulnérabilité était un événement coûteux en temps humain et en expertise. Lorsque ce coût s’effondre, l’hypothèse de rareté qui sous-tend l’embargo ne tient plus. C’est ce constat, formulé pour la première fois aussi clairement par un mainteneur de logiciel critique, qui fait du message de Simon Kelley un signal faible historique.

Trois aveux dans un seul message

Le mail de Simon Kelley contient plusieurs phrases qui méritent d’être citées intégralement. Elles constituent, prises ensemble, un témoignage de première main sur l’état réel de la divulgation responsable en 2026.

Premier aveu, la fatigue opérationnelle d’un mainteneur unique submergé par le volume :

Ce que dit cette phrase, derrière l’apparente sobriété du ton britannique, est que dnsmasq, logiciel d’infrastructure utilisé sur des dizaines de millions de machines, est maintenu par une personne actuellement en train de noyer dans les rapports automatisés. Le mot duplicates est révélateur : il signale que plusieurs chercheurs assistés par IA convergent sur les mêmes patterns, ce qui confirme empiriquement la perte de rareté évoquée plus haut.

Deuxième aveu, la formalisation explicite du pivot doctrinal :

La phrase est posée comme une évidence quasi banale. Elle énonce pourtant une rupture. Lorsque les good guys sont en surnombre suffisant pour que le mainteneur perde le compte, alors la probabilité que les bad guys aient déjà trouvé devient suffisamment élevée pour que l’embargo cesse de protéger. La doctrine s’inverse : la divulgation rapide et publique devient une stratégie de réduction de l’asymétrie informationnelle, et non plus une trahison de l’utilisateur. C’est exactement le raisonnement que faisaient déjà certains chercheurs partisans du full disclosure dans les années 1990, mais émis cette fois par un mainteneur traditionnellement attaché à la coordination.

Troisième aveu, la dimension structurelle et durable du phénomène :

Le terme tsunami n’est pas innocent dans la prose mesurée de Simon Kelley. Il signale que le mainteneur ne traite pas un pic conjoncturel mais une lame de fond qu’il anticipe permanente. La promesse que ce processus sera répété soon implique que le rythme classique des releases sécurité, fondé sur des cycles trimestriels ou semestriels, est lui aussi obsolète. La fréquence des Patch Days devient continue.

Pourquoi maintenant : anatomie du tsunami

Le phénomène que décrit Simon Kelley n’est pas isolé. Il s’inscrit dans une transformation plus large qui s’est accélérée au cours des dix-huit derniers mois. Trois facteurs convergent.

Le premier est la disponibilité d’outils. Les modèles de langage capables de raisonnement sur le code sont désormais accessibles à coût marginal faible. Un agent IA combinant un LLM, un fuzzer, et un système d’analyse de patterns connus peut être déployé par un chercheur individuel sur un budget mensuel inférieur à celui d’un poste de travail haut de gamme. La barrière à l’entrée de la recherche en vulnérabilités sérieuse s’est effondrée. Les équipes commerciales spécialisées qui dominaient ce marché depuis quinze ans se retrouvent en compétition avec des chercheurs indépendants équipés d’outils comparables, voire identiques.

Le deuxième facteur est l’amélioration qualitative des résultats. Les LLM ne se contentent plus de signaler des patterns suspects, ils produisent des analyses contextuelles, identifient les conditions de déclenchement, génèrent des PoC fonctionnels, et formulent des reports lisibles. Un mainteneur ne peut plus écarter un rapport IA d’un coup d’oeil en repérant des artefacts de génération naïve. La qualité moyenne d’un rapport IA en 2026 est comparable à celle d’un rapport humain produit par un chercheur junior, avec l’avantage d’un volume infiniment supérieur.

Le troisième facteur est l’absence de mécanisme de filtrage en amont. Là où les programmes de bug bounty commerciaux disposent de processus de triage industriels, les projets open source maintenus par une à trois personnes reçoivent le tsunami sans intermédiaire. Le triage devient le travail principal du mainteneur, au détriment du développement et de la correction effective.

Le mot duplicates employé par Simon Kelley est l’indicateur statistique le plus important de son message. Lorsque plusieurs chercheurs IA convergent indépendamment sur le même bug, cela démontre empiriquement que la découverte n’est plus rare. Cette convergence vaut démonstration que la doctrine de rareté qui fonde l’embargo classique a cessé d’être opérante. Le doublon n’est plus un inconvénient administratif, c’est une mesure quantitative de l’érosion du modèle.

À ces facteurs techniques s’ajoute une dynamique économique. La compétition entre acteurs IA, qu’ils soient chercheurs indépendants, équipes commerciales ou laboratoires académiques, crée une incitation à la divulgation rapide pour des raisons de réputation et de crédit. Attendre 90 jours pendant qu’un autre chercheur publie le même bug d’abord, c’est perdre l’attribution. Le calcul rationnel du chercheur penche désormais vers la publication accélérée, ce qui exerce une pression supplémentaire sur les mainteneurs et les éditeurs.

Un signal qui résonne avec d’autres ruptures

Le message de Simon Kelley n’est pas le seul indicateur récent d’une crise de la divulgation responsable. La semaine précédente, la divulgation publique non coordonnée des zero-day Windows YellowKey et GreenPlasma par le chercheur Chaotic Eclipse (8) illustrait une autre forme de rupture : un chercheur abandonnant volontairement le modèle CVD pour protester contre les pratiques de silent patching de Microsoft. Les deux affaires partagent une structure commune. Un acteur de la chaîne de divulgation responsable, mainteneur dans un cas, chercheur dans l’autre, prend acte que le modèle ne fonctionne plus selon ses propres règles, et adapte unilatéralement sa pratique.

Les motivations diffèrent. Simon Kelley pivote pour des raisons opérationnelles : la submersion par le volume rend l’embargo coûteux et peu protecteur. Chaotic Eclipse pivote pour des raisons éthiques : le silent patching trahit selon lui le principe de transparence qui fonde la confiance dans la coordination. Mais le résultat est le même : un acte de défection publique vis-à-vis du modèle CVD, motivé par la conviction que ce dernier ne remplit plus la fonction qu’il prétend assurer.

Ces deux signaux faibles, séparés de cinq jours, suggèrent que la doctrine CVD entre dans une phase de remise en cause qui ne relève plus de débats théoriques entre experts mais d’adaptations pratiques par les acteurs concernés. Lorsqu’un mainteneur historique abandonne les longs embargos par épuisement opérationnel, et qu’un chercheur expérimenté abandonne la CVD entière par défiance, le modèle perd ses deux soutiens de base : celui qui maintient et celui qui découvre. Il n’est pas certain qu’il survive dans sa forme actuelle.

Implications opérationnelles pour les organisations

Pour les équipes de sécurité, ce que révèle l’affaire dnsmasq dépasse la nécessité immédiate de patcher. Trois conséquences opérationnelles méritent d’être anticipées.

Compression des fenêtres de patch

Si les embargos longs disparaissent au profit de divulgations rapides ou immédiates, le délai entre la publication d’une CVE et l’exploitation effective se réduit mécaniquement. Les organisations qui fonctionnent sur des cycles de patching mensuels ou trimestriels devront accepter une fréquence plus élevée, ou assumer un risque accru entre deux fenêtres de maintenance. Les outils de virtual patching et les WAF deviennent des compléments structurels, et non plus des palliatifs temporaires.

Augmentation du bruit dans les flux CTI

Le tsunami de bug reports décrit par Simon Kelley va se traduire par une augmentation significative du nombre de CVE publiées chaque trimestre. Les équipes CTI devront affiner leurs capacités de priorisation pour distinguer les vulnérabilités structurantes, dont l’exploitation est avérée ou imminente, des CVE de masse découvertes par fuzzing automatisé dont l’exploitation reste théorique. La métrique CVSS seule devient insuffisante. Les indicateurs comme EPSS, KEV catalog CISA, et les renseignements sur l’exploitation active deviennent les critères de tri opérationnels.

Pression sur les programmes de bug bounty

Les programmes de bug bounty internes ou outsourcés vont subir le même tsunami. La valeur d’un rapport IA isolé tend vers zéro, mais le coût de traitement reste élevé. Les modèles de rétribution devront évoluer pour valoriser la qualité d’analyse et l’exploitabilité démontrée plutôt que la simple détection. Certains acteurs majeurs ont déjà ajusté leurs grilles dans ce sens en 2025 et 2026.

Pour les organisations qui exploitent dnsmasq directement ou indirectement, l’action immédiate est le déploiement de la version 2.92rel2, en attendant la stable 2.93. Les environnements concernés incluent les routeurs OpenWrt, les serveurs Pi-hole, les passerelles Linux maison, les infrastructures DHCP de petites filiales, et les distributions embarquées. Le périmètre est typiquement sous-cartographié dans les outils d’asset management traditionnels.

Vers quelle nouvelle doctrine ?

L’érosion de la CVD ne signifie pas l’absence de doctrine. Elle ouvre une période de recomposition dont les contours commencent à se dessiner. Trois pistes émergent dans les discussions techniques en cours, sans qu’aucune ait encore atteint le statut de consensus.

La première piste est celle des embargos courts et différenciés. Plutôt qu’un délai standard de 90 jours, certains acteurs proposent des fenêtres adaptatives, courtes pour les bugs détectables par fuzzing automatisé (donc probablement déjà découverts ailleurs), longues uniquement pour les vulnérabilités requérant une expertise humaine difficilement réplicable. Cette approche revient à formaliser ce que Simon Kelley fait empiriquement : trier les bugs en fonction de leur probabilité d’avoir été découverts en parallèle.

La deuxième piste est celle de la divulgation publique avec patches synchrones. Plutôt qu’attendre des embargos longs, l’éditeur publie le patch et la description en simultané dès que techniquement possible, en assumant la fenêtre courte entre publication et déploiement client. Cette approche existe déjà pour certains produits, notamment dans le monde Linux kernel où la sécurité par l’ouverture est doctrinale. Elle impose toutefois aux clients en aval une capacité de déploiement quasi temps réel, dont la maturité reste inégale.

La troisième piste, plus disruptive, est celle de la mutualisation des coûts de triage. Si le tsunami de bug reports IA submerge les mainteneurs individuels, plusieurs projets de fondation envisagent des services de triage partagés financés par les utilisateurs industriels. Cette piste pose des questions de gouvernance, de confidentialité des rapports en cours d’analyse, et de soutenabilité économique, mais elle a le mérite de répondre directement au problème de capacité.

Quelle que soit la voie qui s’imposera, le mail de Simon Kelley du 11 mai 2026 restera un marqueur. Pour la première fois, un mainteneur de logiciel d’infrastructure majeur a énoncé publiquement, dans la langue sèche des annonces techniques, que la divulgation responsable telle qu’elle existait depuis trente ans ne tient plus. Cette phrase, glissée entre deux paragraphes sur le tag de la 2.93rc1, aura plus de conséquences à moyen terme que les six CVE qu’elle accompagne.

Les équipes de sécurité, les RSSI, les responsables CTI et les architectes qui s’appuient sur la prévisibilité des cycles de divulgation pour planifier leurs opérations doivent intégrer dès maintenant que cette prévisibilité est en train de disparaître. Non par décision politique, non par rupture spectaculaire, mais par un effet de basculement opérationnel acté un soir de mai par un mainteneur britannique épuisé. C’est souvent ainsi que les ères se terminent.